Un estudiante estudiará para obtener mejores notas. Este tipo de conducta se utiliza porque ha servido previamente como instrumento para conseguir lo mismo y recibe el nombre de “conducta instrumental”.

Primeras Investigaciones sobre Condicionamiento Instrumental

Comienzan con Thorndike. Su intención original era estudiar la inteligencia animal.

Sus experimentos se basaban en introducir animales hambrientos en cajas con comida en el exterior y a la vista del animal. El animal debía aprender cómo salir de la caja.

Los resultados son obvios, con la repetición el animal cada vez tarda menos tiempo en repetir la acción que abre la caja. Sin embargo hay que hacer una puntualización, Thorndike no explicaba que los animales compredieran el funcionamiento del mecanismo que abría la caja, sino que la abrían como una asociación estímulo-respuesta.

Es decir, un gato por ejemplo daba muchas respuestas al introducirlo en la caja, alguna de estas respuestas (de casualidad) abrían la caja, por lo tanto el animal poco a poco iría aprendiendo esta asociación y comenzaría a dar con mayor frecuencia el tipo de respuestas encaminadas a volver a abrirla. Yo no entiendo cómo se abre la puerta de mi coche con el mando a distancia…pero cada vez que quiero abrirla le doy al botón porque es lo que he aprendido.

Ley del efecto: Si una respuesta en presencia de un estímulo es seguida por un suceso satisfactorio, la asociación entre el estímulo (E) y la respuesta (R) se fortalece. Si la respuesta es seguida por un suceso molesto, la asociación E-R se debilita. La ley del efecto implica un aprendizaje E-R.

Aproximaciones modernas al estudio del condicionamiento instrumental

Procedimientos de ensayo discreto

Normalmente se llevan a cabo en laberintos

W.S. Small (1899-1900) creó laberintos para estudiar la conducta de las ratas. Uno tenía forma de T (para estudiar la conducta de elección )y otro era simplemente alargado con forma de I.

Con los laberintos se puede medir la velocidad de la carrera (desde la salida hasta la meta) y el tiempo de latencia (tiempo que tarda en abandonar la salida e iniciar la carrera).

Procedimientos de operante libre

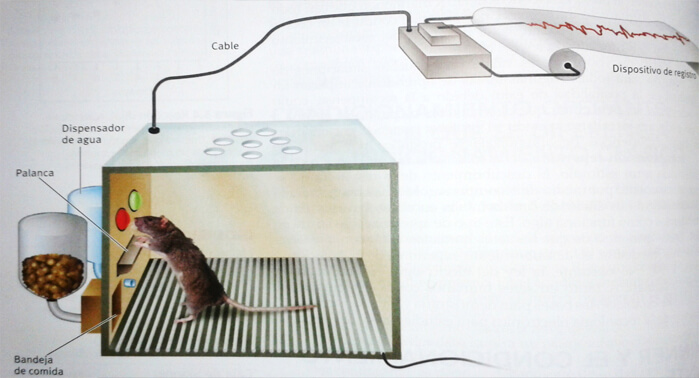

Skinner (1938). Se permite que el animal repita la respuesta una y otra vez sin restricciones.(a diferencia de los laberintos en T en que el animal era sacado del laberinto al llegar a meta). Skinner quería obtener una respuesta más natural en los experimentos. La observación informal sugiere que la conducta en curso es un continuo, una actividad sigue a la otra. Skinner propuso el concepto de operante como la forma de dividir la conducta en unidades medibles con significado.

Rata hambrienta en una caja de Skinner. Hay una palanca conectada a un dispensador de comida. Cuando la rata aprieta la palanca cae comida.

La respuesta operante (presionar la palanca) se define a partir del efecto que produce en el ambiente. El operante de presión de la palanca se define como una presión hacia abajo suficiente para que cause el cierre del microinterruptor. Da igual si la presión la hace con la pata izquierda, derecha o con la cola, se trata del mismo operante.

Entrenamiento y moldeamiento al comedero Es la primera fase. Se realiza un seguimiento del signo mediante un sonido (condicionamiento clásico) para que el animal se dirija al comedero. (esto es el entrenamiento al comedero). Tras este entrenamiento el animal está preparado para aprender la respuesta instrumental. Si la respuesta NO ES ALGO que el animal ya realiza ocasionalmente NUNCA sucederá por si misma la respuesta que produce el reforzador.

Es decir, para empezar le daremos comida a la rata cada vez que se levanta sobre sus dos patas de forma natural (obviamente si en lugar de una rata fuera una rana, nunca podrá ponerse a dos patas). Cuando hemos conseguido la respuesta de alzamiento entonces daremos un paso más y le daremos la comida SOLO SI realiza la respuesta de alzamiento sobre la palanca. Poco a poco vamos produciendo un moldeamiento hasta conseguir la respuesta buscada.

Esta dos fases que hemos visto del modeamiento son: “reforzamiento de aproximaciones sucesivas” y “no reforzamiento de las formas de respuesta tempranas

Moldeamiento y nueva conducta Toda la nueva unidad conductual de la rata está formada por un conjunto de respuestas preexistentes (alzamiento, presión, etc). Es decir, se le enseña una nueva combinación de respuestas familiares en una nueva actividad.

Es importante señalar que el moldeamiento aprovecha la variabilidad inherente de la conducta. Es decir, se puede variar la conducta en una dirección u otra. El libro habla de un experimento sobre el picoteo en palomas en el que dependiendo del reforzador conseguían que su conducta tendiera a ir cerrando más el pico con el picoteo o lo contrario, ir abriendo más el pico con el picoteo.

Con el mismo experimento se obtenían resultados que explicaban que el moldeamiento puede producir nuevas formas de respuesta nunca antes realizadas por el organismo. Antes de los experimentos las palomas conseguían abrir el pico 10 mm, pero tras el moldeamiento llegaban hasta 20 mm.

La tasa de respuesta como medida de la conducta operante Los experimentos con operante libre permiten una observación continua durante largos periodos (a diferencia del ensayo discreto). Skinner propuso la “tasa de ocurrencia” (frecuencia de la respuesta por minuto) como medida de la probabilidad de una respuesta. Las respuestas más probables ocurren con frecuencia y muestran una tasa alta.

Procedimientos de condicionamiento instrumental

Antes de empezar con los procedimientos (que son 4) vamos a explicar 4 conceptos:

- – Estimulo apetitivo: Una consecuencia placentera.

- – Estímulo aversivo: Una consecuencia molesta.

- – Contingencia positiva: La respuesta instrumental proporciona el estímulo (un chico corta el césped y recibe dinero)

- – Contingencia negativa: La respuesta instrumental evita el estímulo (cierro la ventana y no entra lluvia)

Y ahora los 4 procedimientos de los programas de reforzamiento que dan título al apartado

Reforzamiento positivo: Un padre da una galleta a su hija cuando hace los deberes. La respuesta instrumental produce un estímulo apetitivo. Por lo tanto existe contingencia positiva entre la respuesta y el estímulo.

Castigo: Un jefe te critica por llegar tarde a una reunión. La respuesta instrumental produce un estímulo aversivo. Y OJO: Aquí también se produce una contingencia positiva entre la respuesta y el estímulo. (llegar tarde produce que el jefe te riña)

Reforzamiento negativo: Se trata de un procedimiento en el que la respuesta instrumental finaliza o previene la entrega de un estímulo aversivo. Hay dos tipos de reforzamiento negativo:

A)Escape: Se presenta el estímulo aversivo pero puede ser eliminado por la respuesta instrumental. Se puede escapar del sonido molesto de una radio apagándola.

B) Evitación: Implica la programación de un estímulo aversivo para ser presentado en algún momento del futuro. La gente pone a punto su coche para evitar averías.

Entrenamiento de omisión: La respuesta instrumental previene la presentación de un estímulo apetitivo. Se le dice a un niño que se vaya a su habitación cuando ha hecho algo malo no porque la habitación sea algo aversivo sino para evitar estímulos apetitivos como ver la televisión o que lo llamen sus amigos. El entrenamiento de omisión también recibe el nombre de “reforzamiento diferencial de otras conductas” o RDO. El RDO refleja el hecho de que el individuo recibe un estímulo apetitivo periódicamente a condición de que se dedique a realizar otra conducta diferente a la anterior.

Elementos fundamentales del condicionamiento instrumental

El condicionamiento instrumental consta de 3 elementos claves:

- – Una respuesta

- – Una consecuencia (el reforzador)

- – Relación (o contingencia) entre la respuesta y la consecuencia

La respuesta instrumental

Variabilidad conductual versus estereotipia

Los experimentos de Thorndike y Skinner enfatizaron que el reforzamiento incrementa la probabilidad de que la respuesta instrumental se repita en el futuro. Es decir, repeticiones de la misma respuesta. Sin embargo esto no significa que el condicionamiento instrumental no pueda producir también respuestas creativas o variables.

Los organismos pueden aprender a obtener reforzamiento en una situación donde se requiere hacer algo nuevo. Por lo tanto la variabilidad de la respuesta puede ser la base para el reforzamiento instrumental. Y esto se demostró con un experimento en palomas:

Page y Neuringer (1985) – Experimento en Palomas. Las palomas tenían que picotear 2 teclas durante 8 veces para obtener comida. Podían alternar los picoteos como quisieran siempre que fuesen 8 entre dos teclas. Tras 50 ensayos solo recibirían comida si no repetian ninguna de las combinaciones de los 50 ensayos del principio. Paralelamente un grupo de control recibía comida independientemente de si repetía o no. Los resultados demostraron que el grupo que no tenía que repetir las combinaciones daba mucha más variabilidad en su respuesta que el grupo de control, creando combinaciones nuevas.

Por lo tanto:

– La variabilidad de la respuesta puede mantenerse e incrementarse por reforzamiento.

– En ausencia de reforzamiento explícito de la variabilidad, la respuesta llega a ser más estereotipada con un condicionamiento instrumental continuado.

Relevancia o pertinencia en el condicionamiento instrumental

Esto es muy parecido a lo que vimos en el condicionamiento clásico cuando hablábamos de facilidad de aprendizaje cuando el EC era relevante para el EI en temas anteriores.

En el condicionamiento instrumental ocurre algo parecido, Thordike estudió las respuestas de gatos atrapados en cajas. Primeramente condicionó el rascado y el bostezo como respuestas instrumentales para escapar y en otros experimentos condicionó manipular un picaporte o tirar de una anilla.

Demostró que cuando se trataba del picaporte o la anilla, la respuesta era mucho más vigorosa que cuando se trataba del bostezo y el rascado. La evolución natural del gato hace que manipular un picaporte y empujar una anilla son respuestas que están relacionadas de forma natural con escapar de la trampa. Con esto se explica el concepto de pertinencia.

Deriva instintiva: Breland y Breland observaron varias limitaciones y problemas a la hroa de entrenar animales para realizar exhibiciones en circos. Observaron que los animales realizaban conductas relacionadas con su forma de alimentación en lugar de reproducir la conducta buscada por los educadores.

Sistemas de conducta y limitaciones en el condicionamiento instrumental

De acuerdo con la teoría de los sistemas de conducta, cuando un animal está privado de comida y se encuentra en una situación donde podría encontrarla, su sistema de alimentación se activa y se dedica a otras actividades relacionadas con la comida.

De acuerdo con la aproximación de los sistemas de conducta, deberíamos ser capaces de predecir qué respuestas se incrementarán con un reforzamiento de comida mediante el estudio de lo que los animales hacen cuando su sistema de alimentación está activado en ausencia de condicionamiento instrumental. Esto suena un poco lioso pero se entiende con el siguiente ejemplo:

Cuando un hamster tiene comida suficiente se dedica a otras actividades como el autocuidado (lavarse, etc) pero cuando está hambriento su sistema de conducta se centra en otras actividades como rascar o comer. Por lo tanto podemos concluir que el autocuidado no está relacionado con su sistema de conducta de la alimentación y que el reforzamiento de comida podría producir incrementos en actividades como cavar y escarbar pero no en lavarse la cara y rascarse.

El reforzador instrumental

Cantidad y naturaleza del reforzador

Las dos características están muy relacionadas. Tener un reforzador más grande o más sabroso (en el caso de la comida) provocará respuestas más intensas en los sujetos.

Cambios en la naturaleza y cantidad del reforzador

Esto está relacionado con el modelo Rescorla-Wagner visto en el tema anterior.

Si el EI es mayor de lo esperado, producirá condicionamiento excitatorio. Si por el contrario el EI es menor de lo esperado, producirá condicionamiento inhibitorio. Si trabajas por 9 euros/hora durante 6 meses y el septimo mes te siguen pagando lo mismo, será menos emocionante que trabajar 6 meses a 8 euros y luego a partir del septimo mes subirte a 9 euros. Es probable que los trabajadores del segundo grupo sean más productivos.

Contraste positivo: Se refiere a una elevada respuesta por una recompensa favorable resultado de una experiencia anterior con una consecuencia menos atractiva.

Contraste negativo: Se refiere a una respuesta disminuida por una recompensa desfavorable debido a una experiencia anterior con una consecuencia mejor.

Contraste sucesivo (positivo o negativo): Dos condiciones de respuesta en diferentes fases del experimento y sólo un cambio en la magnitud de la recompensa para los grupos de cambio.

Contraste conductual simultáneo: Efectos de contraste conductual (contraste positivo y negativo) que están producidos por frecuentes cambios entre una condición de recompensa favorable y una desfavorable, con cada condición de recompensa asociada a su propio estímulo distintivo.

Todos los efectos de contraste ilustran que la efectividad de un reforzador en una situación está determinada en parte por las experiencias del organismo con reforzadores en otras situaciones.

La relación respuesta-reforzador

En algunos casos hay una fuerte relación entre lo que una persona hace y la consecuencia que sigue, en otros casos no hay ninguna relación y en otros casos la relación puede ser probabilística. Un organismo debe organizar su tiempo para enfrentarse a varios retos y debe hacerlo de manera que lleve a cabo el mejor uso de su tiempo y energía.

2 tipos de relaciones entre una respuesta y un reforzador

a) Relación temporal (o contigüidad temporal): Tiempo que transcurre entre la respuesta y el reforzador. En la “Contigüidad temporal” el reforzador se entrega inmediatamente después de la respuesta.

b) Relación causal: (o contingencia respuesta-reforzador). Se refiere al hecho de que la respuesta instrumental es necesaria y suficiente para la ocurrencia del reforzador.

Efectos de la contigüidad temporal

El reforzamiento inmediato es preferible al demorado. Proporcionar el reforzador inmediatamente después de la ocurrencia de la respuesta instrumental facilita el aprendizaje. Hay varios factores que explican porqué el condicionamiento instrumental es tan sensible a la demora del reforzamiento:

– Una demora larga hace que el sujeto no sepa cual de sus respuestas haya sido la que ha producido el reforzador. Es decir, la rata levanta una palanca pero pasan 30 segundos hasta que se muestra una bolita de comida, durante estos 30 segundos la rata sigue haciendo otras cosas como pueden ser saltar, morder, etc., de repente surge la bolita y la rata ya no asocia la bolita con la palanca inicial ya que después ha seguido dando una serie de respuestas (saltar, morder, etc.) y no sabe cual de ellas ha sido la que ha propiciado la salida de la bolita.

– Para resolver este problema se entrega un reforzador condicionado o secundario inmediatamente después de la respuesta instrumental y que ha sido asociado previamente con el reforzador. Por ejemplo en el adiestramiento verbal de animales se dice “bueno” o “eso es” y cuando acabe la exhibición se le dará la comida.

– Otra manera de resolver el problema es mediante un “procedimiento de marcado” de la respuesta instrumental correcta. Experimento en ratas. Una caja con un brazo negro y otro blanco. El blanco es la respuesta correcta, el grupo de ratas que daba la respuesta correcta se dividió en 2 subgrupos, uno de estos subgrupos era extraido de la caja en el momento de entrar en el brazo blanco y llevado a otra caja a experar la comida.

El otro subgrupo no era extraído de la caja, sino que esperaba a recibir la comida en ella durante 60 segundos. Se demostró que el grupo que era “extraído” (marcado) de la caja, tenía un porcentaje de respuestas correctas superior en experimentos posteriores que el grupo que no había sido extraído. Es decir, hay que hacer algo inmediatamente después de la respuesta instrumental para que el animal se percate de que lo que acaba de hacer es la elección correcta.

La contingencia respuesta-reforzador

Repite lo anterior al principio del apartado pero añade que: Aunque la relación causal sea perfecta, el condicionamiento no ocurrirá si el reforzamiento es demorado durante demasiado tiempo.

El experimento de superstición de Skinner

Muy interesante y gracioso: Metió a 8 palomas en 8 cajas distintas que estaban programadas para dar comida cada 15 segundos independientemente de lo que estuviesen haciendo las palomas. Al rato volvío y comprobó que cada paloma estaba haciendo una cosa, unas daban vueltas otras picoteaban, etc, como si su comportamiento condicionara el hecho de que apareciese o no apareciese comida. Skinner denominó a esto conducta supersticiosa. Seguro que más de uno hacemos cosas parecidas.

Skinner explica esta conducta mediante la idea del reforzamiento accidental o adventicio que se refiere al emparejamiento accidental de una respuesta con la entrega del reforzador. Este experimento sugería que una contingencia positiva respuesta- reforzador no es necesaria para el condicionamiento instrumental.

Reinterpretación del experimento de superstición: Staddon y Simmelhag profundizaron un poco más en el experimento de Skinner y dieron nombre a las conductas de las palomas. Denominaron respuestas terminales a las que se daban al final del intervalo comida- comida y respuestas de interín a las que se daban en medio del intervalo. Las Palomas solían coincidir en el tipo de respuestas terminales y en el tipo de respuestas interín. Por lo tanto hay algo de contingencia entre el tipo de respuestas y el reforzador (al contrario de cómo sugería Skinner)

Explicación de la periodicidad de las respuestas de interín y terminales: Staddon y Simmelhag sugirieron que las respuestas terminales son respuestas típicas de la especie que reflejan la anticipación de comida a medida que el tiempo se encuentra más cerca de la próxima presentación de comida. En contraste, las respuestas interín son una manifestación de otras fuentes de motivación que eran más importantes al comienzo del intervalo entre comidas, cuando la presentación de comida era improbable.

El tipo de respuestas que se dan en el intervalo se agrupan en 3 subgrupos siguiendo el

orden temporal tras la última aparición de comida:

- a) – Búsqueda focalizada poscomida (cerca del cuenco)

- b) – Búsqueda general (lejos del cuenco)

- c) – Búsqueda focalizada (cerca del cuenco otra vez)

Efectos de la controlabilidad de los reforzadores

Con una contingencia fuerte, que el reforzador suceda depende de si ha ocurrido la respuesta instrumental. Un hallazgo importante en experimentos con perros fue que la exposición a una descarga incontrolable dificultaba el aprendizaje posterior. Este efecto recibe el nombre de efecto de indefensión aprendida.

Y ahora 6 puntos que tienen que ver con el efecto de indefensión aprendida:

1. El diseño triádico: (tabla página 153)

Los experimentos de indefensión aprendida se realizan utilizando el diseño triádico. Contiene 2 fases:

a) Exposición

Grupo de ratas E: Expuesto a descargas periódicas de las que pueden escapar.

Grupo de ratas A: Cada sujeto del grupo A es acoplado a cada sujeto del grupo E y recibe las mismas descargas pero no pueden escapar de ellas.

Grupo C: No recibe descargas pero está confinado en el aparato tanto tiempo como los otros.

b) Condicionamiento

Los 3 grupos reciben entrenamiento de escape – evitación

Resultados: La exposición a una descarga incontrolable (Grupo A) produce peores resultados en el aprendizaje escape-evitación que el resto de los grupos. La diferencia en la tasa de aprendizaje entre los grupos muestra que los animales son sensibles a la contingencia respuesta-reforzador.

2. Hipótesis de la indefensión aprendida: Esta hipótesis asume que durante la exposición a descargas incontrolables, los animales aprenden que las descargas son independientes de su conducta, no pueden hacer nada para controlarlas. Esto dificulta el aprendizaje ya que la falta de control sobre la situación hace que descienda la motivación de los sujetos para realizar una respuesta instrumental. No confundir con el efecto de indefensión aprendida que explica el patrón de resultados obtenido con el diseño triádico.

3. Deficit de actividad: Las ratas del Grupo A aprendían a ser inactivas en respuesta a la descarga durante la fase de exposición.

4. Deficit atencional: Una descarga inescapable hace que los animales presten menos atención a sus acciones (ya que han aprendido que van a recibir la descarga hagan lo que hagan). Sin embargo marcar la respuesta instrumental supera el déficit de indefensión aprendida.

5.Relaciones estimulares en el condicionamiento de escape: El rasgo definitorio de la conducta de escape es que la respuesta instrumental tiene como consecuencia la terminación del estímulo aversivo. Además, la respuesta de escape tiene como resultado claves internas de retroalimentación de la respuesta. Hay dos:

– Claves de retroalimentación de la terminación de la descarga. (al comienzo de la respuesta de escape)

– Claves de retroalimentación de la señal de seguridad. (cuando el animal completa la respuesta)

Estas claves contextuales llegan a convertirse en inhibidores condicionados del miedo y limitan el miedo elicitado por las claves contextuales de la cámara experimental. Hay mayor probabilidad que las claves contextuales de la cámara en la que se administran las descargas queden condicionadas para elicitar miedo cuando las descargas son inescapables.

Para finalizar y a modo de conclusión: El diseño triádico ha sido de un valor incalculable para considerar la posible importancia de las contingencias respuesta-reforzador.